Google Cloud и NVIDIA расширяют партнерство для масштабирования разработки искусственного интеллекта

Google Cloud и NVIDIA расширяют партнерство для масштабирования разработки искусственного интеллекта. Новые предложения и интеграции инфраструктуры искусственного интеллекта делают искусственный интеллект более открытым и доступным. Google Cloud и NVIDIA сегодня объявили об углубленном партнерстве, которое позволит сообществу машинного обучения (ML) получить технологию, которая ускоряет их усилия по легкому созданию, масштабированию и управлению генеративными технологиями. ИИ-приложения. Чтобы продолжать привносить прорывы в области искусственного интеллекта в свои продукты и разработчиков, Google объявила о внедрении новой вычислительной платформы NVIDIA Grace Blackwell для искусственного интеллекта, а также облачного сервиса NVIDIA DGX в Google Cloud. Кроме того, облачная платформа DGX на базе NVIDIA H100 теперь общедоступна в Google Cloud. Опираясь на недавнее сотрудничество по оптимизации семейства открытых моделей Gemma , Google также внедрит микросервисы вывода NVIDIA NIM , чтобы предоставить разработчикам открытую, гибкую платформу для обучения и развертывания с использованием предпочитаемых ими инструментов и платформ. Компании также объявили о поддержке JAX на графических процессорах NVIDIA и экземплярах Vertex AI на базе графических процессоров NVIDIA H100 и L4 Tensor Core. «Сила нашего долгосрочного партнерства с NVIDIA начинается на уровне аппаратного обеспечения и распространяется на весь наш портфель — от современных графических ускорителей до экосистемы программного обеспечения и нашей управляемой платформы Vertex AI», — сказал генеральный директор Google Cloud. Томас Куриан . «Вместе с NVIDIA наша команда стремится предоставить высокодоступную, открытую и комплексную платформу искусственного интеллекта для разработчиков машинного обучения». «Предприятия ищут решения, которые позволят им в полной мере воспользоваться преимуществами генеративного искусственного интеллекта за недели и месяцы, а не за годы», — сказал Дженсен Хуанг, основатель и генеральный директор NVIDIA. «Благодаря расширенным предложениям по инфраструктуре и новой интеграции с полнофункциональным ИИ NVIDIA Google Cloud продолжает предоставлять клиентам открытую, гибкую платформу для легкого масштабирования генеративных приложений ИИ». Новая интеграция между NVIDIA и Google Cloud основана на давнем стремлении компаний предоставить сообществу ИИ передовые возможности на каждом уровне стека ИИ. Ключевые компоненты расширения партнерства включают в себя: Принятие NVIDIA Grace Blackwell:новая платформа Грейс Блэквеллпозволяет организациям создавать и выполнять логические выводы в реальном времени на больших языковых моделях с триллионом параметров. Google использует эту платформу для различных внутренних развертываний и станет одним из первых облачных провайдеров, предлагающих экземпляры на базе Blackwell. Облако DGX на базе Grace Blackwell переходит в Google Cloud: Google перенесет системы NVIDIA GB200 NVL72, которые объединяют 72 графических процессора Blackwell и 36 процессоров Grace, соединенных между собой NVLink пятого поколения, в свою высокомасштабируемую и производительную облачную инфраструктуру. Разработанный для энергоэффективного обучения и вывода в эпоху LLM с триллионами параметров, он также будет доступен через DGX Cloud, платформу искусственного интеллекта, предлагающую бессерверный опыт для корпоративных разработчиков, создающих и обслуживающих LLM. DGX Cloud теперь общедоступен на экземплярах виртуальных машин Google Cloud A3 на базе графических процессоров NVIDIA H100 Tensor Core. Поддержка JAX на графических процессорах. Google Cloud и NVIDIA совместно использовали преимущества JAX для графических процессоров NVIDIA, расширяя доступ к крупномасштабному обучению LLM среди более широкого сообщества ML. JAX — это платформа для высокопроизводительного машинного обучения, ориентированная на компилятор и родная для Python, простая в использовании и производительная среда для обучения LLM. Специалисты по искусственному интеллекту теперь могут использовать JAX с графическими процессорами NVIDIA H100 в Google Cloud черезМакстекстиКомплект ускоренной обработки (ХПК). NVIDIA NIM на Google Kubernetes Engine (GKE): микросервисы вывода NVIDIA NIM, являющиеся частью программной платформы NVIDIA AI Enterprise, будут интегрированы в GKE. Основанный на механизмах вывода, включая TensorRT-LLM, NIM помогает ускорить развертывание генеративного ИИ на предприятиях, поддерживает широкий спектр ведущих моделей ИИ и обеспечивает плавный и масштабируемый вывод ИИ. Поддержка NVIDIA NeMo: Google Cloud упростил развертывание инфраструктуры NVIDIA NeMo на своей платформе с помощьюДвижок Google Кубернетес(ГКЭ) иНабор инструментов Google Cloud HPC. Это позволяет разработчикам автоматизировать и масштабировать обучение и обслуживание генеративных моделей ИИ, а также позволяет им быстро развертывать готовые среды с помощью настраиваемых проектов, которые запускают процесс разработки.NVIDIA НеМо, часть NVIDIA AI Enterprise, также доступна на Google Marketplace, предоставляя клиентам еще один способ легкого доступа к NeMo и другим платформам для ускорения разработки ИИ. Vertex AI и Dataflow расширяют поддержку графических процессоров NVIDIA. Для развития науки о данных и аналитики Vertex AI теперь поддерживает виртуальные машины Google Cloud A3 на базе графических процессоров NVIDIA H100 и виртуальные машины G2 на базе графических процессоров NVIDIA L4 Tensor Core. Это предоставляет командам MLOps масштабируемую инфраструктуру и инструменты для уверенного управления и развертывания приложений искусственного интеллекта. Dataflow также расширил поддержку ускоренной обработки данных на графических процессорах NVIDIA. Google Cloud уже давно предлагает экземпляры виртуальных машин с графическим процессором, оснащенные новейшим оборудованием NVIDIA в сочетании с ведущими инновациями Google. Графические процессоры NVIDIA являются основным компонентом Google Cloud ИИГиперкомпьютер - суперкомпьютерная архитектура, объединяющая оптимизированное по производительности оборудование, открытое программное обеспечение и гибкие модели потребления. Комплексное партнерство позволяет исследователям, ученым и разработчикам ИИ обучать, настраивать и обслуживать самые крупные и сложные модели ИИ — теперь с еще большим количеством их любимых инструментов и платформ, совместно оптимизированных и доступных в Google Cloud. «Платформа преобразования текста в видео Runway основана на гиперкомпьютере с искусственным интеллектом. В основе виртуальные машины A3 на базе графических процессоров NVIDIA H100 обеспечили нашему обучению значительный прирост производительности по сравнению с виртуальными машинами A2, что позволило проводить крупномасштабное обучение и делать выводы для нашей модели Gen-2. ... Использование GKE для организации наших учебных заданий позволяет нам масштабироваться до тысяч графических процессоров H100 в единой структуре, чтобы удовлетворить растущий спрос наших клиентов». - Анастасис Германидис, технический директор и соучредитель Runway. «Перейдя в Google Cloud и используя архитектуру гиперкомпьютера AI с графическими процессорами NVIDIA T4, виртуальными машинами G2 на базе графических процессоров NVIDIA L4 и сервером вывода Triton, мы добились значительного повышения производительности вывода нашей модели, одновременно снизив затраты на хостинг на 15 % с помощью новых методов, реализованных гибкость, которую предлагает Google Cloud». — Эшвин Каннан, старший инженер по машинному обучению, Palo Alto Networks «Платформа Writer создана благодаря этому чрезвычайно продуктивному партнерству с Google и NVIDIA. Мы можем оптимально использовать графические процессоры NVIDIA для обучения и вывода. Мы используем NVIDIA NeMo для создания наших промышленных моделей, которые генерируют 990 000 слов в секунду с более чем триллион вызовов API в месяц. Мы поставляем модели высочайшего качества, которые превосходят модели компаний с более крупными командами и большими бюджетами – и все это возможно благодаря партнерству Google и NVIDIA. Преимущества их опыта в области искусственного интеллекта передаются нашим корпоративным клиентам, которые могут создавать значимые рабочие процессы искусственного интеллекта за дни, а не месяцы или годы». - Дэнни Люнг , директор Alliances, писатель Узнайте больше о сотрудничестве Google Cloud с NVIDIA на GTC, глобальной конференции по искусственному интеллекту, которая пройдет 18–21 марта (стенд № 808). Источник: www.nvidianews.nvidia.com

Пост взят с международного финтех-медиа ресурса

ДЛЯ ЛЮДЕЙ

![Аватар сообщества NVIDIA [новости]](/uploads/community/1/1712251182_db31c65d08b0368b5ff54be96c90cc17.jpg)

![Аватар сообщества TESLA [новости]](/uploads/community/2/66ea8c2b-c1b2-4605-bc1a-9185b2727ad9.jpg)

![Аватар сообщества CHEVRON [новости]](/uploads/community/4/fd9f64cd-9735-4c6a-93ae-d356d9daf48d.jpg)

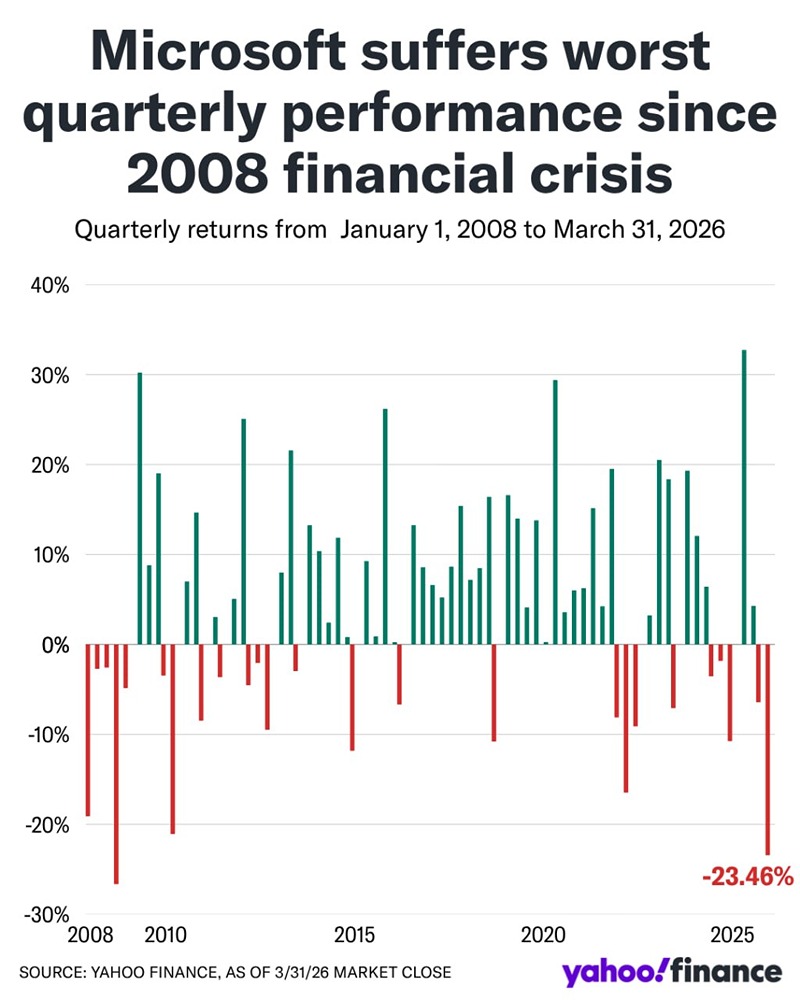

![Аватар сообщества MICROSOFT [новости]](/uploads/community/1/1712244752_f1077befa4c2ba0b9a839842f135968b.jpg)

![Аватар сообщества AMAZON [новости]](/uploads/community/2/5b1b15e0-1cfd-4b12-8b0b-c041d6ef4d4f.jpg)

![Аватар сообщества CITIGROUP [новости]](/uploads/community/1/aba8a597-6d94-4ab0-a448-c1d527ebedd8.jpg)

![Аватар сообщества MCDONALD'S [новости]](/uploads/community/4/ffc93c60-b81b-4fe9-9ca2-1f583373866d.jpg)

![Аватар сообщества VISA [новости]](/uploads/community/3/86208ff5-1668-4a4d-9f38-1d5a6a2cd64b.jpg)

![Аватар сообщества JPMORGAN [новости]](/uploads/community/1/ce52cd1a-4068-42b6-9dfb-5a9fcd7de8f3.jpg)

![Аватар сообщества BLACKROCK [новости]](/uploads/community/2/0aa9a4b4-4be8-485f-944a-086aba6b5102.jpg)

![Аватар сообщества GOLDMAN SACHS [новости]](/uploads/community/1/ff5c3044-1b80-4619-87d5-89cda4894b30.jpg)

![Аватар сообщества BOOKING [новости]](/uploads/community/3/10ac0068-9704-4b0d-8fa8-37ea6f2e9cdb.jpg)

![Аватар сообщества STRATEGY [новости]](/uploads/community/5/ed1ed55f-f7cc-43b9-be84-d64f3fb01d12.jpg)

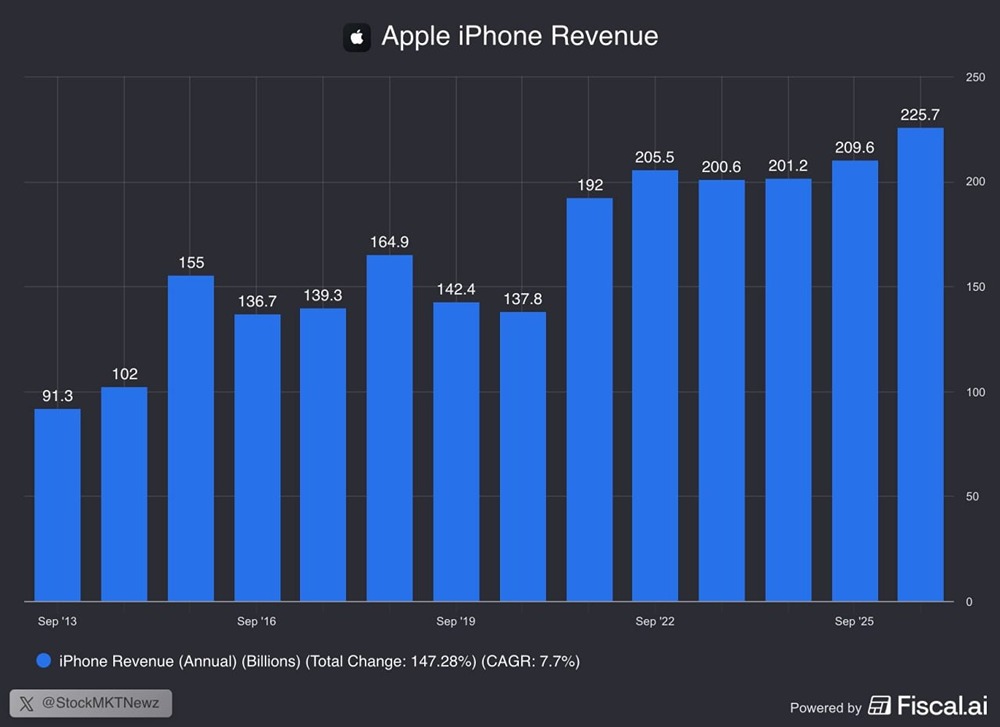

![Аватар сообщества APPLE [новости]](/uploads/community/2/1651f5f9-00e6-46d0-90ec-1b8c7dd0adcd.jpg)

![Аватар сообщества WALT DISNEY [новости]](/uploads/community/3/c782e61c-7766-4880-8610-5db8e5e1c5fb.jpg)

![Аватар сообщества STARBUCKS [новости]](/uploads/community/4/ed32d594-7f54-45a5-b07c-6af5f963258b.jpg)

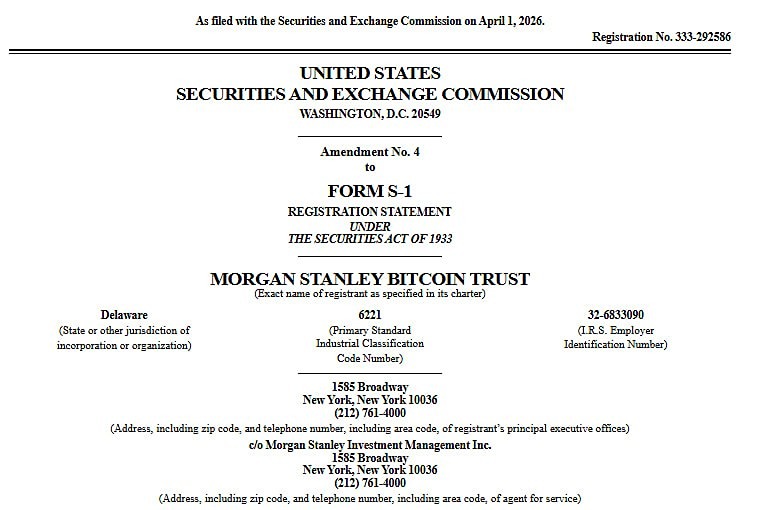

![Аватар сообщества MORGAN STANLEY [новости]](/uploads/community/10/76330125-47dd-4473-81c7-95886ad1fb20.jpg)

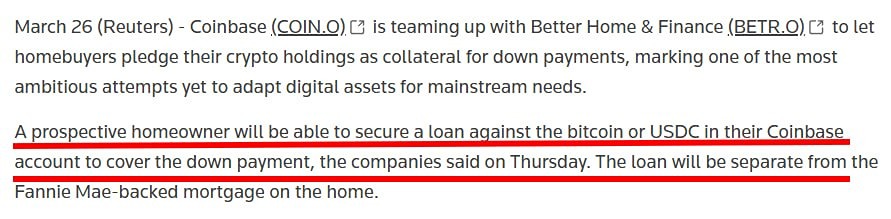

![Аватар сообщества COINBASE [новости]](/uploads/community/5/36c5528b-4d80-4400-9e6c-10b55d54beee.jpg)

![Аватар сообщества MASTERCARD [новости]](/uploads/community/3/1867dd73-3f99-4da8-a5e7-fcb370911df1.jpg)

![Аватар сообщества ALPHABET [новости]](/uploads/community/2/1712310220_ff8cf36099c4dff41c9a3ece1045d01c.jpg)

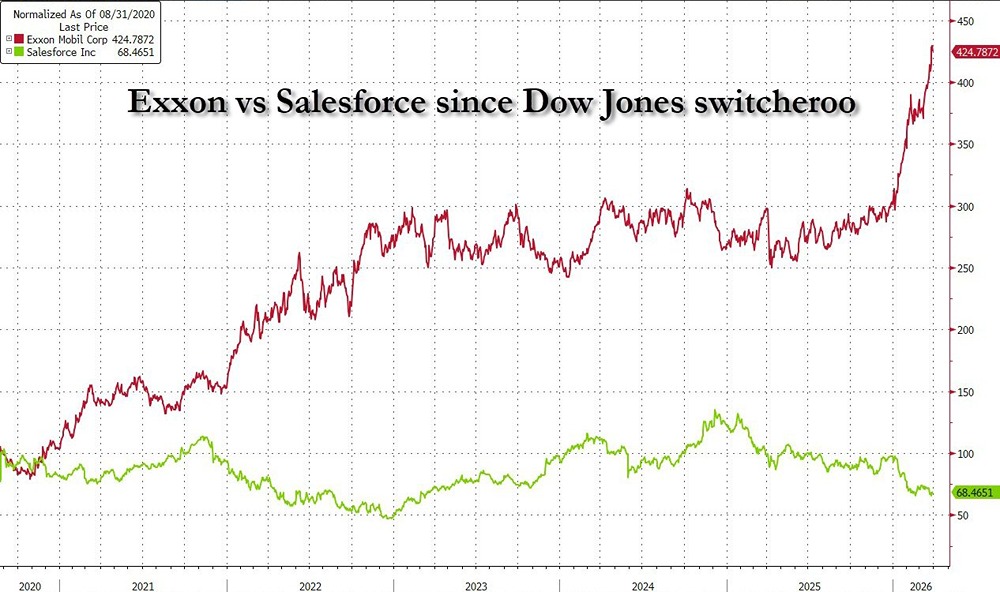

![Аватар сообщества EXXON MOBIL [XOM] [анализ]](/uploads/community/4/67e2a8c8-9748-4da4-a461-8b5fb8b92f4b.jpg)

![Аватар сообщества NIKE [новости]](/uploads/community/4/297f9872-1934-43a7-957f-5a0dd2739eba.jpg)

![Аватар сообщества ORACLE [новости]](/uploads/community/3/1712398533_430f34c801de10b6cd641b1ddeba714a.jpg)

![Аватар сообщества DOMINO'S PIZZA [новости]](/uploads/community/8/7cc111a5-e82b-40fb-8fa4-e96a803ff97d.jpg)

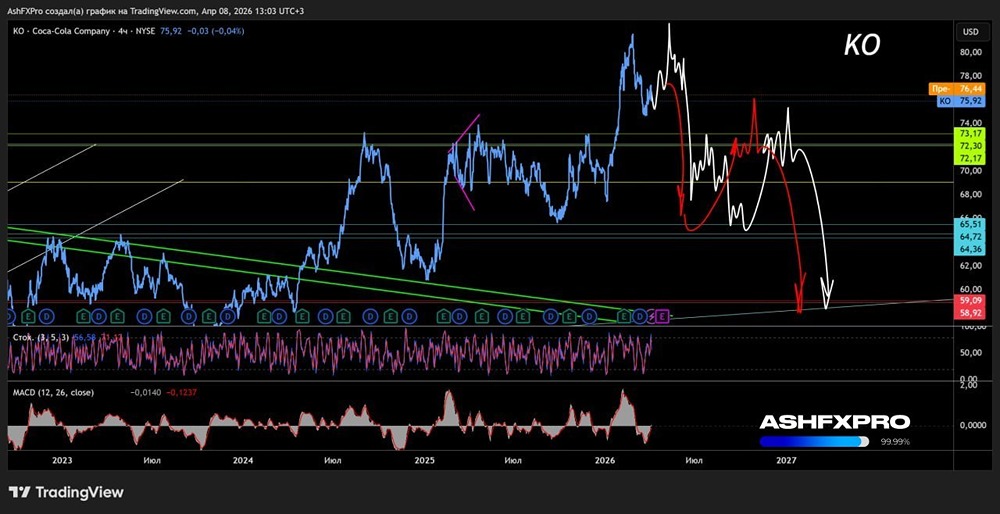

![Аватар сообщества COCA-COLA [KO] [анализ]](/uploads/community/4/1712495168_ae3926a611d7c41ce0a814eda9a46180.jpg)

![Аватар сообщества FREEDOM [новости]](/uploads/community/3/6b3aaebc-ce12-47a8-8948-52afc5a5f980.jpg)