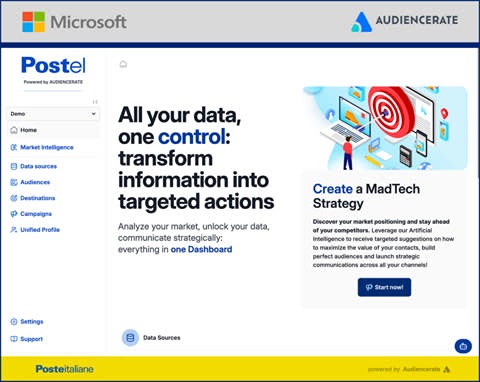

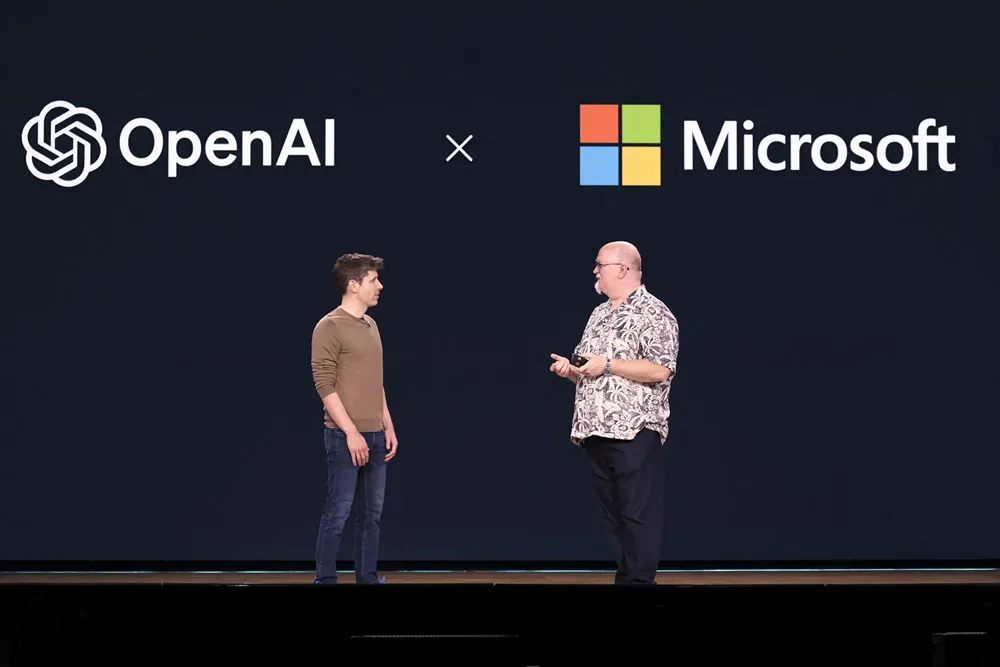

Microsoft увеличивает ответственную команду по искусственному интеллекту с 350 до 400 человек

Microsoft увеличивает ответственную команду по искусственному интеллекту с 350 до 400 человек. Корпорация Microsoft расширила команду, отвечающую за безопасность своих продуктов искусственного интеллекта, увеличив в прошлом году штат сотрудников с 350 до 400 человек. Более половины группы уделяет этой задаче полный рабочий день, сообщила компания в среду в своем первом ежегодном отчете о прозрачности искусственного интеллекта, в котором излагаются меры по обеспечению ответственного развертывания ее услуг. В состав дополнительных членов команды входят как новые сотрудники, так и существующие сотрудники. В прошлом году Microsoft распустила свою команду по этике и обществу на фоне масштабных увольнений в технологическом секторе, которые уничтожили команды по доверию и безопасности в различных компаниях, включая Meta Platforms Inc. и Google, принадлежащую Alphabet Inc. Microsoft стремится повысить доверие к своим генеративным инструментам искусственного интеллекта на фоне растущей обеспокоенности по поводу их склонности генерировать странный контент. В феврале компания расследовала инциденты с участием своего чат-бота Copilot, чьи ответы варьировались от странных до вредных. В следующем месяце инженер-программист Microsoft разослал письма совету директоров, законодателям и Федеральной торговой комиссии, предупреждая, что технологический гигант не предпринимает достаточных мер для защиты своего инструмента создания изображений с помощью искусственного интеллекта Copilot Designer от создания оскорбительного и жестокого контента. «Мы в Microsoft осознаем свою роль в формировании этой технологии», — говорится в отчете компании из Редмонда, штат Вашингтон. Подход Microsoft к безопасному развертыванию искусственного интеллекта основан на концепции, разработанной Национальным институтом стандартов и технологий. Агентству, входящему в состав Министерства торговли, было поручено разработать стандарты для новых технологий в рамках указа, изданного в прошлом году президентом Джо Байденом. В своем первом отчете Microsoft заявила, что внедрила 30 ответственных инструментов искусственного интеллекта, в том числе те, которые усложняют людям задачу заставить чат-ботов с искусственным интеллектом действовать странно. «Быстрые щиты» компании предназначены для обнаружения и блокирования преднамеренных попыток — также известных как атаки с быстрым внедрением или взлома — заставить модель ИИ вести себя непреднамеренным образом. Автор: Jackie Davalos. Источник: www.bloomberg.com

Пост взят с международного финтех-медиа ресурса

ДЛЯ ЛЮДЕЙ

![Аватар сообщества MICROSOFT [новости]](/uploads/community/1/1712244752_f1077befa4c2ba0b9a839842f135968b.jpg)

![Аватар сообщества TESLA [новости]](/uploads/community/2/66ea8c2b-c1b2-4605-bc1a-9185b2727ad9.jpg)

![Аватар сообщества VISA [новости]](/uploads/community/3/86208ff5-1668-4a4d-9f38-1d5a6a2cd64b.jpg)

![Аватар сообщества APPLE [новости]](/uploads/community/2/1651f5f9-00e6-46d0-90ec-1b8c7dd0adcd.jpg)

![Аватар сообщества MASTERCARD [новости]](/uploads/community/3/1867dd73-3f99-4da8-a5e7-fcb370911df1.jpg)

![Аватар сообщества FEDEX [новости]](/uploads/community/2/f95e1a48-7cbc-447d-9c8e-ceba54fce4fa.jpg)

![Аватар сообщества BERKSHIRE HATHAWAY [новости]](/uploads/community/10/7e54b741-708c-42d7-ae4a-6641b2044f74.jpg)

![Аватар сообщества MORGAN STANLEY [новости]](/uploads/community/10/76330125-47dd-4473-81c7-95886ad1fb20.jpg)

![Аватар сообщества CHEVRON [новости]](/uploads/community/4/fd9f64cd-9735-4c6a-93ae-d356d9daf48d.jpg)

![Аватар сообщества ALPHABET [новости]](/uploads/community/2/1712310220_ff8cf36099c4dff41c9a3ece1045d01c.jpg)

![Аватар сообщества JOHNSON & JOHNSON [новости]](/uploads/community/3/79fc3a28-a17b-4e8d-b965-e42db9f2fe19.jpg)

![Аватар сообщества IBM [новости]](/uploads/community/4/91864cab-6c2c-4724-9361-7351055d7e58.jpg)

![Аватар сообщества BOOKING [новости]](/uploads/community/3/10ac0068-9704-4b0d-8fa8-37ea6f2e9cdb.jpg)

![Аватар сообщества JPMORGAN [новости]](/uploads/community/1/ce52cd1a-4068-42b6-9dfb-5a9fcd7de8f3.jpg)

![Аватар сообщества BOEING [новости]](/uploads/community/2/e753d30c-7fcf-4cda-92b4-6f792168f040.jpg)

![Аватар сообщества FORD [новости]](/uploads/community/2/59785168-9b8d-4bd1-82b4-73154ba3aa0a.jpg)

![Аватар сообщества GENERAL MOTORS [новости]](/uploads/community/2/1712337275_fa0d472d3af880017f2137eea0bd8529.jpg)

![Аватар сообщества ADOBE [новости]](/uploads/community/2/1e138d44-8ee7-4551-abe5-f5b2258eb927.jpg)

![Аватар сообщества AMD [новости]](/uploads/community/1/d92e339e-b35e-4b0f-ba72-ede6bc3fcf63.jpg)

![Аватар сообщества PEPSICO [новости]](/uploads/community/4/1712495283_40fa4822575a0c08d3a0d7aec0d06c8c.jpg)

![Аватар сообщества INTEL [новости]](/uploads/community/1/9163d0cd-bb51-41d2-a061-110ccef0fb3b.jpg)

![Аватар сообщества EBAY [новости]](/uploads/community/8/9a4e81d8-2f6d-444b-86a2-44560f6e3182.jpg)

![Аватар сообщества MCDONALD'S [новости]](/uploads/community/4/ffc93c60-b81b-4fe9-9ca2-1f583373866d.jpg)

![Аватар сообщества DOMINO'S PIZZA [новости]](/uploads/community/8/7cc111a5-e82b-40fb-8fa4-e96a803ff97d.jpg)

![Аватар сообщества ORACLE [новости]](/uploads/community/3/1712398533_430f34c801de10b6cd641b1ddeba714a.jpg)