Языковая модель

YandexGPT 5 Lite Pretrain: большая языковая модель. Яндекс представил YandexGPT 5 Lite Pretrain — большую языковую модель (LLM) с 8 миллиардами параметров, способную понимать контекст до 32 тысяч токенов. Модель превосходит зарубежные аналоги по качеству ответов и может быть адаптирована под любые задачи. Модель обучалась на русскоязычных и англоязычных текстах, коде, вычислениях и других данных общим объёмом 15 триллионов токенов, что эквивалентно 2,5 миллиардам веб-страниц. На втором этапе использовались высококачественные данные объёмом 320 миллиардов токенов, включая образовательные тексты. Яндекс улучшил метод отбора данных для обогащения модели. Модель компактна и не требует больших вычислительных мощностей, что делает её полезной для разработки, бизнеса и научных исследований. По сравнению с предыдущими версиями, она показывает значительный рост качества в решении математических задач и написании кода, а также лидирует в большинстве типов задач. В 2022 году Яндекс уже публиковал модель YaLM-100B и продолжает делиться открытыми решениями в области ML, включая библиотеку YaFSDP для ускорения обучения LLM до 25%. YandexGPT 5 Lite Pretrain бесплатна на платформе HuggingFace и является частью семейства YandexGPT 5. Модель YandexGPT 5 Pro доступна на облачной платформе Yandex Cloud и в чате с Алисой. Для её обучения использовались методы обучения с подкреплением DPO и PPO, а также модификация LogDPO для повышения стабильности. Оптимизация процесса обучения снизила потребность в вычислительных ресурсах на 25%. Источник: www.yandex.ru

Пост взят с международного финтех-медиа ресурса

ДЛЯ ЛЮДЕЙ

![Аватар сообщества ЯНДЕКС [новости]](/uploads/community/2/dca78d58-9d3f-48a0-8d3a-7bf714273ff3.jpg)

![Аватар сообщества ММК [новости]](/uploads/community/4/188833b7-8245-4c80-9257-389ed69ec360.jpg)

![Аватар сообщества АЭРОФЛОТ [новости]](/uploads/community/5/7a624f5f-aa75-4c36-bddb-054ca1f17650.jpg)

![Аватар сообщества Т-ТЕХНОЛОГИИ [новости]](/uploads/community/2/b5eba32b-39f9-45bd-a190-8b27d30411c5.jpg)

![Аватар сообщества ГАЗПРОМ НЕФТЬ [новости]](/uploads/community/4/1013fb93-41a0-457a-a9ac-772f2d38d37b.jpg)

![Аватар сообщества МТС [новости]](/uploads/community/2/3eb48c63-edb4-4484-a73d-0d3b20bc449c.jpg)

![Аватар сообщества АСТРА [новости]](/uploads/community/6/59710997-0577-44b5-b43c-2d6094945593.jpg)

![Аватар сообщества СБЕР [новости]](/uploads/community/1/14da43a9-fa4d-4096-b0ba-be5678da01e1.jpg)

![Аватар сообщества МОСКОВСКАЯ БИРЖА [новости]](/uploads/community/3/56b18cb3-9e1d-470e-9604-182d46ef036c.jpg)

![Аватар сообщества НЛМК [новости]](/uploads/community/6/01aed878-fc39-43a6-98db-b661dfbe776f.jpg)

![Аватар сообщества ТАТНЕФТЬ [новости]](/uploads/community/2/1712321343_8b8c76b7548186c658ddb4e6d4bddbd5.jpg)

![Аватар сообщества ДЕЛИМОБИЛЬ [новости]](/uploads/community/7/44a9403a-d102-41ce-b730-9001c3288ea5.jpg)

![Аватар сообщества КАМАЗ [новости]](/uploads/community/7/357c0a50-6818-4bf6-bb19-5cc2e0507547.jpg)

![Аватар сообщества ОАК [новости]](/uploads/community/3/e3421103-5f45-474a-9e6f-c2a989ba677d.jpg)

![Аватар сообщества ПОЗИТИВ [новости]](/uploads/community/6/1712605680_f2686d4814462e7121fcf08d8701b0e8.jpg)

![Аватар сообщества МТС-БАНК [новости]](/uploads/community/7/60c2f13e-ef0e-4026-a1f1-b6c795fa4887.jpg)

![Аватар сообщества МКБ [новости]](/uploads/community/2/9ae80732-178f-4aaa-9b97-3bc948c459e8.jpg)

![Аватар сообщества ХЭНДЕРСОН [новости]](/uploads/community/4/fd8bb5f5-1d5e-4a55-aa98-9914e4786f3d.jpg)

![Аватар сообщества ДОМ.РФ [новости]](/uploads/community/12/a9267a3b-9633-4c72-bc4c-f9ee5bdb2833.jpg)

![Аватар сообщества РУСАГРО [новости]](/uploads/community/4/db47bba1-8150-4f2c-b7f1-f2e5f6157435.jpg)

![Аватар сообщества АФК СИСТЕМА [новости]](/uploads/community/5/dbc4b2b4-8f18-4134-a0f0-07e7e15dc384.jpg)

![Аватар сообщества РОССЕТИ [новости]](/uploads/community/6/5cf7ed04-8664-416a-b76c-ed4f5adad232.jpg)

![Аватар сообщества ЛУКОЙЛ [новости]](/uploads/community/1/2c96ceab-14df-487b-9a3f-e8248e743add.jpg)

![Аватар сообщества СОФТЛАЙН [новости]](/uploads/community/3/37921205-79f0-4064-a68c-f63938195ac2.jpg)

![Аватар сообщества ТРАНСНЕФТЬ [новости]](/uploads/community/2/068fe35f-9411-4f55-ac84-ed989235d1e2.jpg)

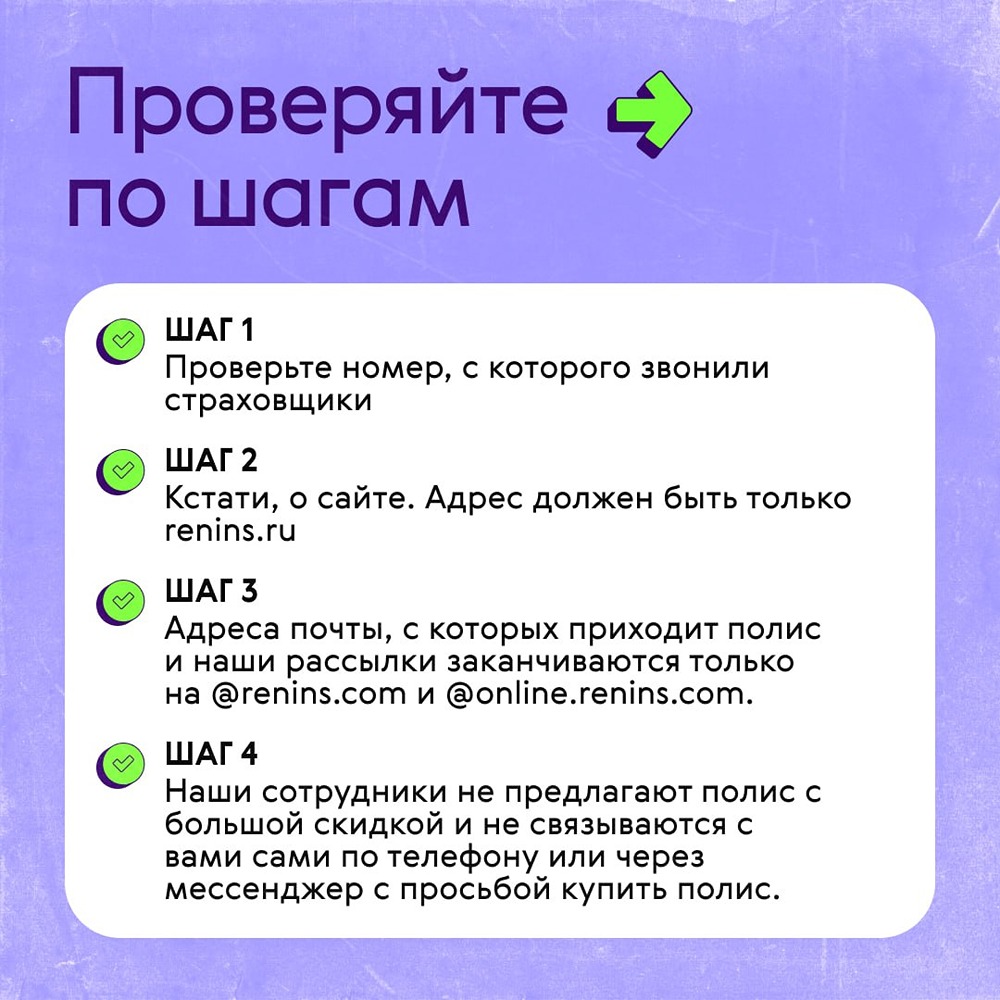

![Аватар сообщества РЕНЕССАНС [новости]](/uploads/community/4/affd052d-8b4a-4e71-85a6-2455333d9535.jpg)

![Аватар сообщества ТГК-1 [новости]](/uploads/community/7/4e7cbcd7-b941-4eec-8643-c4ad11131e35.jpg)

![Аватар сообщества ЭТАЛОН [новости]](/uploads/community/6/94e51d9d-f269-46eb-b21e-10e3510cf283.jpg)

![Аватар сообщества ЕВРОПЛАН [новости]](/uploads/community/7/278b8b35-5eae-4781-aff7-4e2da101eb0b.jpg)

![Аватар сообщества ЕВРОТРАНС [новости]](/uploads/community/3/323f5382-1c7a-43f0-8e31-edd6faade926.jpg)

![Аватар сообщества ГАЗПРОМ [новости]](/uploads/community/1/25ea6f9d-52e1-4709-965c-46893deaac40.jpg)