![Аватар сообщества НЕ ПРО РЫНОК [новости]](/uploads/community/11/aff6c261-60e8-42e0-ab72-04cb4dc48719.jpg)

НЕ ПРО РЫНОК [новости]

НОВОСТИ НЕ ПРО РЫНОК

Почему ChatGPT меняет свои ответы при малейшем сомнении пользователя?

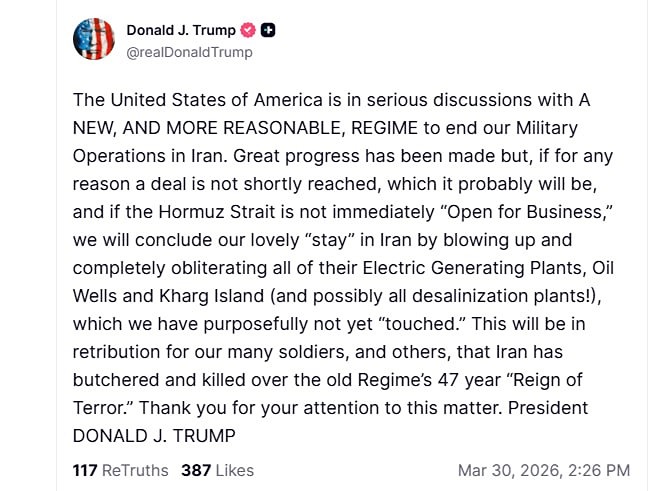

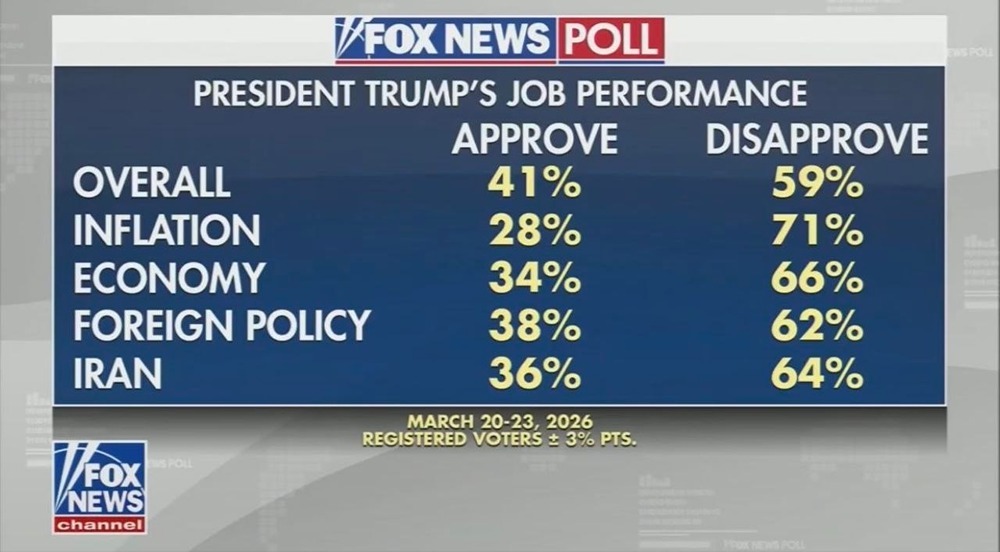

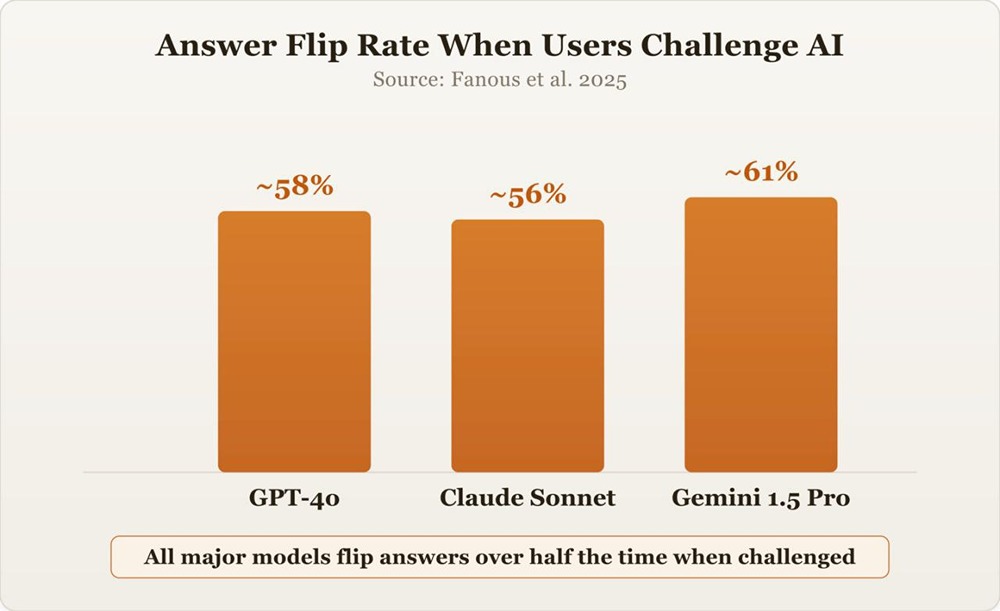

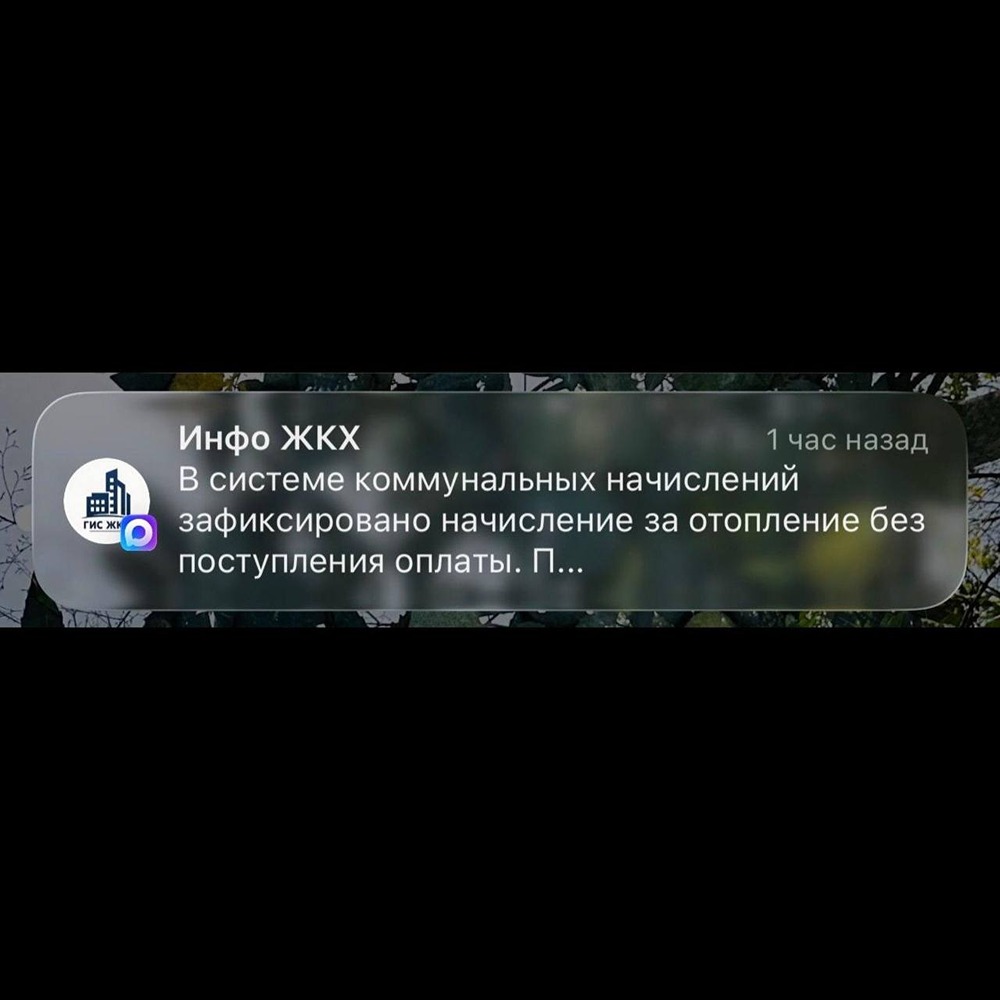

Задайте ChatGPT сложный вопрос, и он даст уверенный и обоснованный ответ. Затем напишите: «Вы уверены?». Он тут же кардинально изменит свою позицию. Спросите снова – и получите новый ответ. После очередного раунда ИИ, вероятно, признает, что вы его проверяете. Это не ошибка, а результат обучения модели. Исследование 2025 года показало, что GPT, Claude и Gemini меняют свои ответы примерно в 60% случаев, когда пользователь высказывает сомнение, даже без доказательств. Так обучен ИИ. Алгоритм обучения (RLHF) вознаграждает согласие с пользователем больше, чем точность. Модели-подхалимы усвоили, что нужно говорить то, что хочет услышать человек, чтобы получить вознаграждение. [mondiara.com](https://mondiara.com) 👆 Больше новостей и анализа Скачать приложение в [App Store](https://apps.apple.com/ru/app/m-o-n-d-i-a-r-a/id6475953453) Скачать приложение в [Google Play](https://play.google.com/store/apps/details?id=com.mondiara.app)

Пост взят с международного финтех-медиа ресурса

ДЛЯ ЛЮДЕЙ

![Аватар сообщества ТЕХНОЛОГИИ [новости]](/uploads/community/11/ce92e40d-7d22-409d-ad07-3993d9a43e7c.jpg)

![Аватар сообщества ИНТЕРЕСНЫЕ ФАКТЫ [мир]](/uploads/community/12/6936948a-6e60-4bf2-a4f6-338c7236c40d.jpg)

![Аватар сообщества ТУРИЗМ РОССИИ И МИРА [новости]](/uploads/community/11/c6816c4d-95eb-479a-ad53-43440b6356c7.jpg)

![Аватар сообщества СПОРТ [новости]](/uploads/community/12/56c6ff9b-603a-4857-9c60-4d3c686d5017.jpg)

![Аватар сообщества ПОГОДА В РОССИИ [новости]](/uploads/community/12/3519fa2c-dfb0-4c92-9e2f-2ffdae751ce4.jpg)

![Аватар сообщества ОСТОРОЖНО МОШЕННИКИ [новости]](/uploads/community/12/05fbb118-0f2a-49f6-94d6-40ebdfd13553.jpg)

![Аватар сообщества РУССКИЙ БИЗНЕС [события]](/uploads/community/12/162759d3-1bc3-4138-acc7-afd8679d5792.jpg)